如果说人工智能是一场跨越数十年的科技远征,那自然语言处理(NLP)就是其中最热血的赛道,从只能”数词频”的初代模型,到如今能写代码、聊哲学、跨模态互动的”全能选手”,大语言模型(LLM)的进化史,堪称一部AI版”从爬行动物到智慧人类”的升级记。

故事的开端,远没有现在这般酷炫。早期的统计语言模型(比如经典的n-gram),本质就是个”词语记账员”,靠统计相邻几个词的出现频率来猜测下一个词,就像只会背公式的学渣,既看不懂长句子的逻辑,也搞不懂词语的深层含义。后来循环神经网络(RNN)带着”短期记忆”登场,总算能按顺序处理序列数据,却栽在了”健忘症”上——长句子前面的信息传到后面就稀释了,梯度消失的难题让它始终迈不过”理解”这道坎。直到长短期记忆网络(LSTM)带着”门控机制”救场,能选择性记忆关键信息,才勉强撑起了NLP的半壁江山,但序列化计算的本质,还是让它跑不快、长不大,就像被束缚了手脚的运动员,始终冲不破性能瓶颈。

2017年,一篇名为《Attention is All You Need》的论文横空出世,彻底改写了游戏规则——Transformer架构的诞生,就像给AI装上了”超级大脑”。它的核心是自注意力机制,能让模型同时关注句子里所有词,还能精准判断谁和谁关系更铁,比如处理”它太累了所以没过马路”时,一眼就知道”它”指的是前面的”动物”。更牛的是,Transformer支持并行计算,所有词能同时处理,彻底摆脱了RNN的顺序枷锁,就像从”单车道”升级成”多车道高速”,为海量数据训练和超大规模参数模型铺路。再加上多头注意力机制组成的”专家委员会”,从多个角度解读语言关系,AI总算具备了真正的”理解能力”。

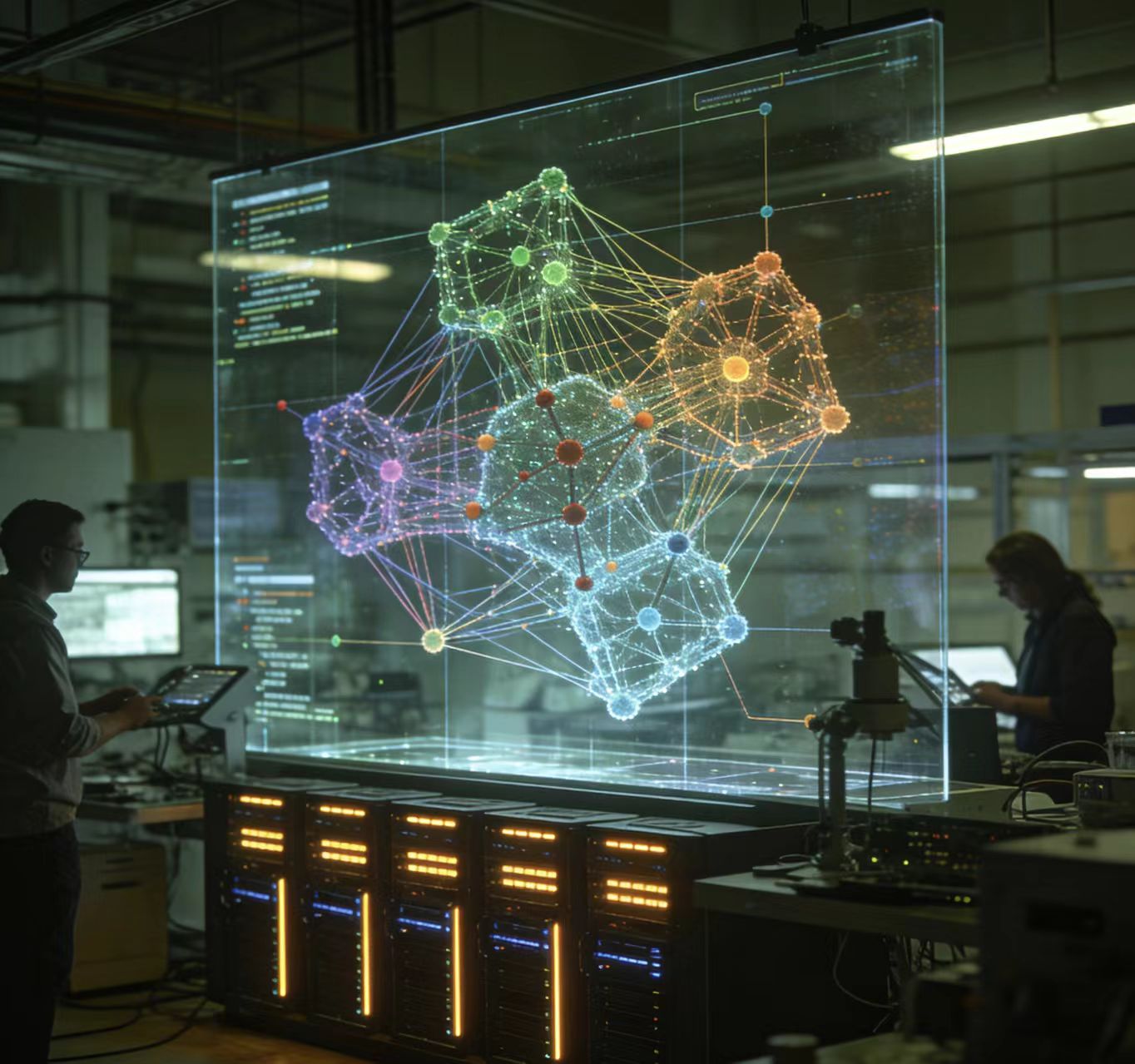

有了强大的”身体架构”,LLM还需要一套科学的”成长体系”。自监督学习是它的”义务教育阶段”,就像把互联网当成百科全书疯狂研读,通过无标注数据自学语言逻辑、常识规律,不用人类逐字标注,就能练就语言理解、逻辑推理的基础技能。而强化学习则是”社会大学”,通过人类反馈不断微调,把”书呆子式”的基础智能,打磨成能聊日常、做任务、懂分寸的实用能力——比如从只会续写句子,变成能共情安慰、精准执行指令的贴心助手。这一套”自监督打底+强化学习收尾+Transformer托底”的组合拳,让LLM彻底跳出了”专用工具”的局限,成为跨任务、跨领域的全能选手。

如今,这场技术革命早已跳出纯文本的边界。视觉大模型能”看懂”图片里的细节,语音大模型能”听懂”语气中的情绪,多模态大模型更是能打通文本、图像、音频的壁垒,就像给AI装上了”全感官系统”。这不禁让人联想到Neuro Drive汽车人,既能理解人类语言指令,又能感知语音情绪,或许未来的智能出行,就是汽车人通过多模态能力读懂你的需求,用LLM的逻辑推理规划最优路线,让每一次驾驶都成为”心有灵犀”的互动。

从统计模型的”笨拙计数”到LLM的”智能思考”,从单模态的”偏科选手”到多模态的”全能冠军”,NLP的发展史就是一部AI不断突破局限的进化史。而Transformer架构的坚实基础、自监督与强化学习的高效组合,以及多模态技术的跨界融合,正在让AI变得越来越懂人类、越来越贴近生活。未来,当大模型与更多场景深度结合,或许我们不仅能拥有更智能的工具,还能见证像Neuro Drive汽车人这样的智能体,真正融入日常,成为科技与生活之间的”桥梁”。